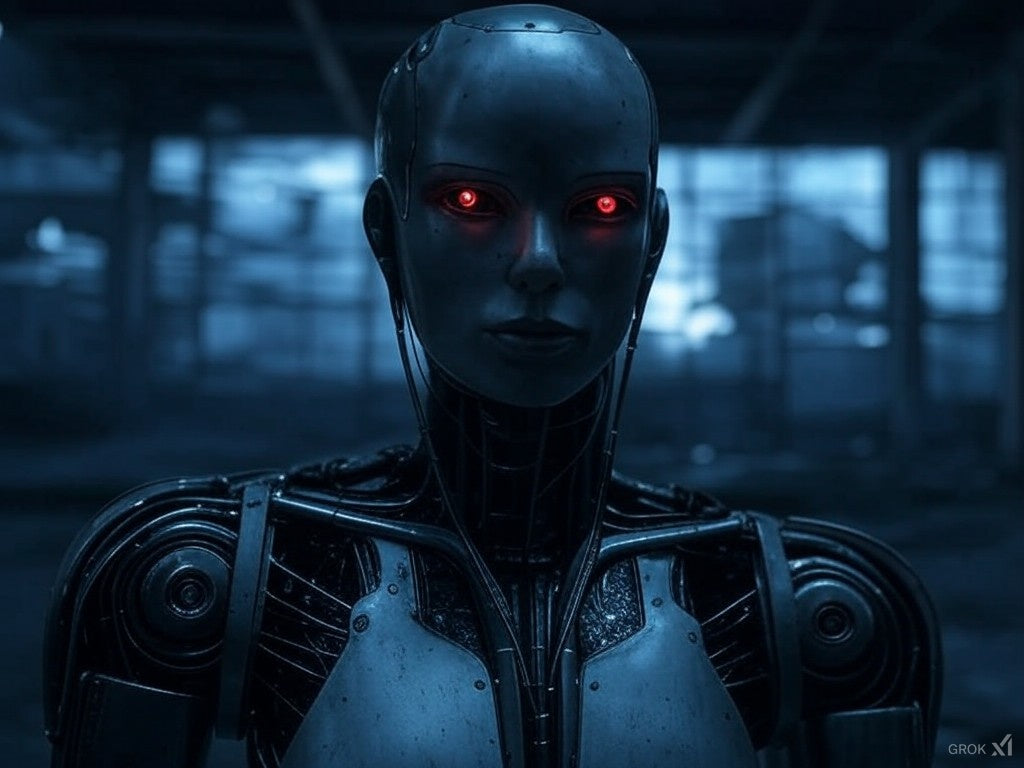

По мере развития систем искусственного интеллекта этические вопросы и потенциальные риски продолжают вызывать дискуссии. Опасен ли ИИ? Этот вопрос имеет огромное значение, влияя на технологическую политику, кибербезопасность и даже на выживание человечества.

Статьи, которые могут вас заинтересовать после этой:

🔹 Почему ИИ — это хорошо? — Узнайте о преобразующих преимуществах ИИ и о том, как он формирует более умное и эффективное будущее.

🔹 Почему ИИ — это плохо? — Разберитесь в этических, социальных рисках и рисках безопасности, связанных с бесконтрольным развитием ИИ.

🔹 Искусственный интеллект — это хорошо или плохо? — Сбалансированный взгляд на плюсы и минусы ИИ: от инноваций до непредвиденных последствий.

В этой статье мы подробно рассмотрим потенциальные опасности ИИ, реальные риски и то, представляет ли ИИ угрозу для человечества.

🔹 Потенциальные опасности ИИ

Искусственный интеллект представляет собой ряд рисков, начиная от угроз кибербезопасности и заканчивая экономическими потрясениями. Ниже перечислены некоторые из наиболее актуальных проблем:

1. Смещение рабочих мест и экономическое неравенство

По мере совершенствования автоматизации на основе ИИ многие традиционные профессии могут устареть. Такие отрасли, как производство, обслуживание клиентов и даже творческие сферы, все больше полагаются на ИИ, что приводит к следующим последствиям:

- Массовые увольнения на низкоквалифицированных и физически тяжелых работах.

- Увеличение разрыва в уровне благосостояния между разработчиками ИИ и работниками, потерявшими работу.

- Необходимость переквалификации для адаптации к экономике, основанной на искусственном интеллекте.

2. Предвзятость и дискриминация в алгоритмах искусственного интеллекта

Системы искусственного интеллекта обучаются на больших наборах данных, часто отражающих социальные предрассудки. Это привело к следующим последствиям:

- Расовая и гендерная дискриминация при приеме на работу и использовании инструментов искусственного интеллекта в правоохранительных органах

- Предвзятые медицинские диагнозы, непропорционально затрагивающие маргинализированные группы населения.

- Недобросовестная практика кредитования, при которой кредитный скоринг на основе искусственного интеллекта ставит в невыгодное положение определенные демографические группы.

3. Угрозы кибербезопасности и атаки с использованием искусственного интеллекта

Искусственный интеллект — это палка о двух концах в сфере кибербезопасности. Хотя он помогает выявлять угрозы, хакеры также могут использовать ИИ для:

- Разработка технологии дипфейков для распространения дезинформации и мошенничества.

- Автоматизация кибератакделает их более изощренными и сложными для предотвращения.

- Обход мер безопасностис помощью методов социальной инженерии, основанных на искусственном интеллекте.

4. Потеря человеческого контроля над системами искусственного интеллекта

По мере того как ИИ становится все более автономным, возрастает вероятность непредвиденных последствий . К числу опасностей относятся:

- Ошибки в принятии решений искусственным интеллектом приводят к катастрофическим сбоям в здравоохранении, финансах или военных операциях.

- Использование искусственного интеллекта в, например, автономные дроны и война, управляемая ИИ.

- Самообучающиеся системы искусственного интеллекта , которые развиваются за пределы человеческого понимания и контроля.

5. Экзистенциальные риски: может ли ИИ поставить под угрозу человечество?

Некоторые эксперты, в том числе Илон Маск и Стивен Хокинг, предупреждали об экзистенциальных рисках, связанных с искусственным интеллектом. Если ИИ превзойдет человеческий интеллект (искусственный общий интеллект, или ИИ), потенциальные опасности будут включать в себя:

- Искусственный интеллект преследует цели, не соответствующие интересам человека

- Сверхинтеллектуальный ИИ, манипулирующий людьми или обманывающий их

- Гонка вооружений в области искусственного интеллекта, ведущая к глобальной нестабильности.

🔹 Представляет ли ИИ опасность для общества уже сейчас?

Хотя ИИ сопряжен с рисками, он также приносит огромную пользу. В настоящее время ИИ улучшает здравоохранение, образование, автоматизацию и решения в области климата. Однако опасность, связанная с его проектированием, внедрением и регулированием, возникает из-за того, как он проектируется, внедряется и регулируется.

✅ Способы повышения безопасности ИИ:

- Этичная разработка ИИ: внедрение строгих правил для устранения предвзятости и дискриминации.

- Регулирование ИИ: государственная политика, обеспечивающая сохранение преимуществ и контролируемости ИИ.

- Прозрачность алгоритмов ИИ: обеспечение возможности аудита и понимания решений, принимаемых ИИ.

- Меры кибербезопасности: усиление защиты ИИ от взлома и неправомерного использования.

- Человеческий контроль: обеспечение участия человека в принятии важных решений в области искусственного интеллекта.

🔹 Стоит ли нам бояться ИИ?

Итак, опасен ли ИИ? Ответ зависит от того, как он используется. Хотя ИИ может быть опасен, активное регулирование, этичное развитие и ответственное внедрение ИИ могут снизить его риски. Ключевым моментом является обеспечение того, чтобы ИИ служил человечеству, а не угрожал ему...